Westworld: Vi har fått sympati med robotene

TV-serien Westworld er et uttrykk for at holdningene våre til roboter er i endring, sier amerikansk forsker.

For tiden ruller andre sesong av HBOs kritikerroste serie «Westworld» over skjermen. Hvis du ikke kjenner den, kan vi raskt oppsummere hva den handler om: roboter, cowboyer, vold og sex.

Det høres ut som ren underholdning, men serien reiser faktisk også dypere spørsmål om bevissthet, etikk og kunstig intelligens.

I forlystelsesparken Westworld kan gjestene nemlig dra på ferie i ville vesten, og parkens beboere er roboter som er programmert til å spille med på det gjestene ønsker seg.

Og det mange ønsker seg ser ut til å være å begå grusomme overfall og overgrep på de stakkars robotene.

I en ny artikkel, utgitt i det vitenskapelige tidsskriftet Science Robotics, argumenterer Robin R. Murphy for at serien er et uttrykk for at vi har endret holdningene våre til roboter.

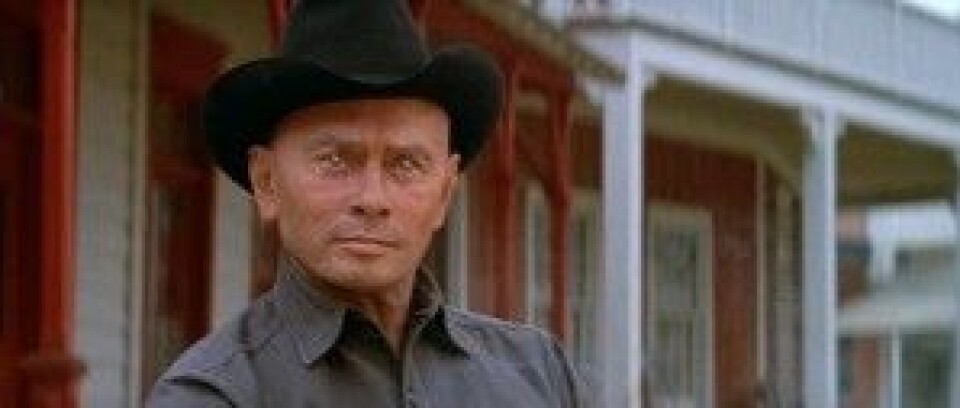

For i den originale filmen Westworld fra 1973 er historien helt annerledes. Her er det roboten «Gunslinger» som blir rammet av et virus som får den til å angripe parkens stakkars gjester. Med andre ord fryktet vi robotene i 1973 – mens vi i 2018 har sympati med dem, skriver forskeren, som er professor ved Texas A&M University.

Vi får sympati med de som ligner oss

Det er ingen tvil om at robotene har blitt mer menneskelige i det nye Westworld. De ligner mennesker, de beveger seg som mennesker – og de begynner så smått å tenke som mennesker også.

Og det er en av grunnene til at de vekker sympati, mener Murphy.

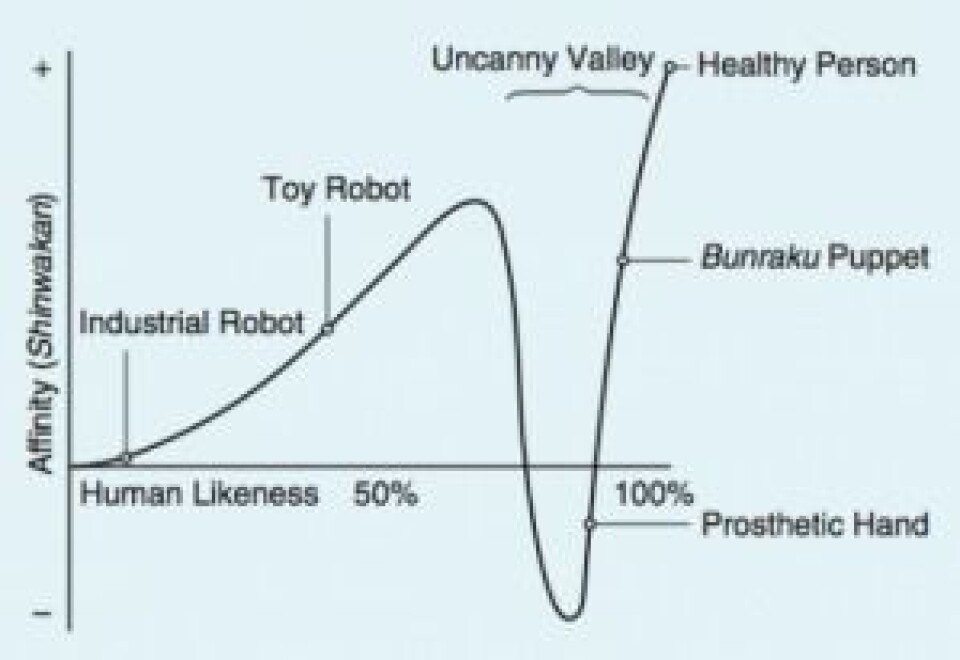

Det baserer han blant annet på teorien om «den uhyggelige dalen», tenkt ut av den japanske robotforskeren Masahiro Mori i 1970.

Ifølge teorien er det et punkt, før robotene ligner helt på mennesker, der de vil være svært skremmende, men når de kommer over på den annen side av det punktet, får vi empati med dem.

Svak og sterk AI

Ifølge Robin R. Murphy knytter «den uhyggelige dalen» seg ikke bare til utseende og bevegelse, men også til intelligens. Og her mener han at robotene i Westworld fra 1973 bare er besittelse av det han kaller «weak AI», mens de i den nye Westworld har «strong AI».

- Svak AI (også kalt snever AI) kan bare løse spesifikke oppgaver. Siri på en iPhone er et godt eksempel, ettersom den arbeider ut fra definerte kommandoer.

- Sterk AI er derimot en generell intelligens med bevissthet og vilje. Den kan gjøre mer enn å reagere på kommandoer – den kan også forstå innholdet.

De to begrepene ble første gang av den amerikanske filosofen John Searle, som på 1980-tallet argumenterte for at maskiner aldri ville bli intelligente på samme måte som mennesker.

Kjent filosof: Robotene i Westworld kan ikke føle noe

John Searle vil imidlertid neppe selv mene at robotene i Westworld er i besittelse av «sterk AI».

For selv om de ser ut til å bli glade eller leie seg, smiler og gråter, så vil de ifølge John Searles argumentasjon aldri oppleve smerte eller glede – det ser bare slik ut.

– Ifølge Searle er denne formen for intelligens ikke mulig i annet enn biologisk materiale, sier Thor Grünbaum, som er førsteamanuensis ved Institutt for medier, erkjennelse og formidling ved Københavns Universitet, der han blant annet forsker på bevissthetsfilosofi.

Og for Searle er det likegyldig hvor avanserte robotene er, og om de for eksempel kan snakke med oss.

– Searle postulerer at maskiner fungerer ut fra et logisk regelsett definert av produsentene, og derfor vil de aldri kunne forstå selve innholdet av det de sier eller gjør, sier Grünbaum.

Det kinesiske rommet

John Searle argumenterer for sin oppfatning med et eksempel som han kaller «det kinesiske rommet».

Rommet kan svare på alle mulige spørsmål på kinesisk, og det fungerer ved at man putter en strimmel papir med spørsmålet inn gjennom en sprekk, og etter kort tid kommer et svar tilbake.

Utenfra virker rommet intelligent, og det synes i stand til å forstå kinesisk – men forestill deg så at det inne i rommet faktisk bare sitter en danske som ikke kan ett ord kinesisk.

Til gjengjeld har han en stor bok der det står alle mulige sekvenser av kinesiske tegn, og hva han skal svare på dem med.

– Tanken er at hvert svar kan gis helt uten at du kan kinesisk, eller uten at du forstår hva du gjør. En slik maskin her er drevet av regler, mens menneskelig forståelse involverer forståelse av verden, sier Grünbaum.

Utenfra virker det altså som om at rommet har en bevissthet, men siden mannen inne i verken forstår de kinesiske tegnene som kommer inn av sprekken, eller de svarene han sender tilbake, selv blir han bare en passasjer uten adgang til innholdet.

På samme måte vil en datamaskin eller en robot kunne virke bevisst selv om den bare følger et forutbestemt regelsett.

Bevisstheten skiller datamaskiner og mennesker

Searle er altså overbevist om at en intelligens tilsvarende den menneskelige aldri vil opptre i et materiale som en datachip.

Men det er ikke bred enighet innenfor filosofien. Hvis man for eksempel mener at våre mentale egenskaper kan defineres ut fra sin funksjon, så burde det også være mulig å gjenskape mentale egenskaper i en gjenstand som kan utføre samme funksjon.

– Ifølge funksjonalismen burde vi kunne lage en datamaskin som bruker de samme prinsippene som hjernen vår, hvis vi kan finne ut hva de er. Og da vil det altså være det samme programmet i datamaskinen og i hjernen, sier Grünbaum.

Men det er et problem.

– Det er en rekke kognitive operasjoner som vi kan definere funksjonelt – for eksempel å kjenne forskjell på to forskjellige sanseinntrykk eller regne ut et budsjett. Men bevisstheten har vi ikke lykkes å finne en funksjon for, og vi kan ikke beskrive den funksjonelt, sier Grünbaum.

Skal roboter ha rettigheter?

Uansett om det er realistisk at robotene i Westworld kan føle noe, eller om de bare later om, så er seriens tema et uttrykk for en økt interesse for hvordan vi bruker teknologi, og om roboter skal ha rettigheter, mener Anne Gerdes, som er førsteamanuensis ved Institutt for design og kommunikasjon ved Syddansk Universitet, der hun blant annet forsker på etiske spørsmål i forbindelse med kunstig intelligens og robotteknologi.

– Noen vil mene at det å gi roboter rettigheter er litt som å gi en brødrister rettigheter. På samme måte var det et mediestunt da roboten Sophia fikk statsborgerskap i Saudi-Arabia. I virkeligheten har vi jo ikke nådd dit at robotene utvikler følelser, slik vi ser det i Westworld, sier hun.

Men selv om roboter i dag er dumme, sett i det perspektivet, så er det faktisk forskere, som den amerikanske forskeren David Gunkel, som mener vi bør gi roboter rettigheter – også for vår egen skyld. Argumentet er at hvis vi behandler menneskeliknende roboter ondsinnet, så kan det skade vår egen moral.

– Ifølge talsmenn for robotrettigheter handler det ikke så mye om hva roboten er. I stedet bør man se på hva som skjer i forholdet mellom menneske og robot. Hvis vi etablerer følelsesmessige relasjoner med roboter, vil noen forskere argumentere for at vi bør behandle roboter etisk forsvarlig og tildele dem rettigheter, sier Gerdes.

EU arbeider med lovgivning

Det er ikke bare forskerne som diskuterer etikk i forhold til roboter og kunstig intelligens.

Europa-parlamentet debatterer også behovet for lovgivning om roboter – blant annet i forbindelse med erstatning etter ulykker forårsaket av selvkjørende biler.

– Her er det imidlertid ikke rettighetsspørsmålet det gjelder. Men det handler om roboten som agent som handler autonomt i verden, og hvem som skal ha ansvaret for det, sier Gerdes.

Vi kan ikke se hva kunstig intelligens «tenker»

Dette er bare en av problemstillingene som har oppstått i kjølvannet på kunstig intelligens, forteller Anne Gerdes. Hun er overbevist om at det vil komme enda flere dilemmaer i fremtiden.

En annen problemstilling er at kombinasjonen av store datamengder og kunstig intelligens gjør at systemer kan treffe beslutninger uten at vi kan forklare hvordan systemene faktisk har nådd frem til den beslutningen.

– Det er det vi kaller black box-problemet. Kunstig intelligens kan effektivt fordele barnehageplasser eller avgjøre noen typer av juridiske saker bedre enn et menneske, men i komplekse sammenhenger kan vi ikke nødvendigvis utrede hvordan den har kommet frem til svaret, sier Gerdes.

For eksempel har den tyrkiske dataforskeren Zeynep Tufekci i en TED-talk advart om ikke å overlate ansettelsen av nye medarbeidere til kunstig intelligens, blant annet fordi den kan diskriminere mot personer som har risiko for å utvikle depresjon i fremtiden – eller sortere ut på helt andre kriterier vi ikke kan se.

Anne Gerdes mener imidlertid likevel ikke at det utelukkende er en negativ utvikling.

– Kunstig intelligens rommer mange positive muligheter. Men det er viktig at vi holder øye med hva som skjer, og at vi tar opp etikken, slik at vi kan være proaktive for den teknologiske utviklingen går raskt, sier hun.

Referanse:

R.R. Murphy: «Westworld and the uncanny valley», Robin R. Murphy, Science Robotics, DOI: 10.1126/scirobotics.aat8447 Sammendrag

© Videnskab.dk. Oversatt av Lars Nygaard for forskning.no.